Nel suo ultimo report intitolato “Big Ideas 2024”, Ark Invest, guidata da Cathie Wood, ha previsto che la convergenza di hardware e software ha il potenziale di ridurre i costi di formazione dell’intelligenza artificiale del 75% all’anno fino al 2030.

Cosa è successo

Il report è stato condiviso mercoledì e ha toccato diversi argomenti, tra cui la convergenza tecnologica, l’IA, l’allocazione dei Bitcoin, i consumatori digitali e altro ancora.

Nel fornire informazioni sull’IA, il report ha affermato che i modelli di IA come il GPT-4 di OpenAI, che hanno prestazioni incredibili in vari compiti, dovrebbero aumentare la produttività in modo significativo.

“Scossi dal momento ‘iPhone’ di ChatGPT, le aziende si stanno affrettando a sfruttare il potenziale dell’intelligenza artificiale (IA)”, si legge nel report, che aggiunge: “L’IA promette molto più che un aumento dell’efficienza, grazie alla rapida diminuzione dei costi e ai modelli open-source. Se la produttività dei lavoratori della conoscenza dovesse quadruplicare entro il 2030, come riteniamo probabile, la crescita del PIL reale potrebbe accelerare e superare i record nei prossimi cinque-dieci anni”.

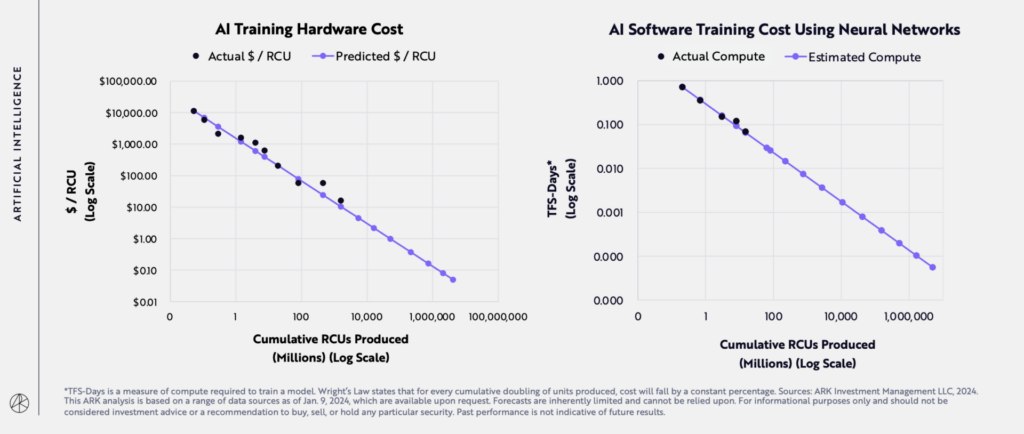

Per fornire maggiori dettagli sulle potenziali riduzioni dei costi di formazione dell’IA, il report cita la Legge di Wright, affermando che “i miglioramenti nell’hardware di calcolo accelerato dovrebbero ridurre i costi di produzione delle unità di calcolo relative all’IA (RCU) del 53% all’anno, mentre i miglioramenti dei modelli algoritmici potrebbero ridurre ulteriormente i costi di formazione del 47% all’anno”.

“In altre parole, la convergenza di hardware e software potrebbe ridurre i costi di formazione dell’IA del 75% all’anno fino al 2030”.

Perché è importante

I modelli linguistici di grandi dimensioni come GPT-4, PaLM, Claude, Bard, LaMDA e LLaMA continuano a fiorire, ma la creazione e l’addestramento di questi modelli sono costosi. Comportano l’utilizzo di migliaia di unità di elaborazione grafica o GPU per gestire le enormi quantità di dati da cui vengono appresi.

Solo le GPU possono costare milioni di dollari. Ad esempio, il modello linguistico GPT-3 di OpenAI ha richiesto almeno 5 milioni di dollari di GPU per ogni sessione di addestramento, ha riportato Forbes.

Quando a luglio, durante un evento del MIT, è stato chiesto il costo dell’addestramento dei modelli di fondazione, il cofondatore di OpenAI Sam Altman ha dichiarato che si trattava di “più di” 100 milioni di dollari.

“At the MIT event, Altman was asked if training GPT-4 cost $100 million; he replied, “It’s more than that.””

Throwing money/compute at a problem is easier than retaining innovative thinkers to advance the state of the art. Sounds like the low-hanging fruit has been picked. https://t.co/YfvMLSJkGs

— Glenn K. Lockwood (@glennklockwood) April 17, 2023

Il previsto calo dei costi di formazione sull’IA da parte di Ark Invest ha il potenziale di rendere le tecnologie dell’IA più accessibili a una più ampia gamma di settori, di alimentare l’innovazione nell’IA, di aiutare le aziende a implementare un maggior numero di soluzioni di IA per migliorare l’efficienza e automatizzare le attività, di avere un impatto sull’attuale mercato del lavoro e di aumentare l’integrazione dell’IA nella nostra vita quotidiana.

Inoltre, potrebbe anche aumentare l’attenzione sulle considerazioni etiche e sui quadri normativi.